M2 Apprentissage et Algorithmes (M2A)

Master Mathématiques et Applications / Master Informatique – Sorbonne Université

Quelques précisions au sujet de la thèse proposée au LEMTA :

Le cerveau, qui est l’organe le plus complexe du corps humain, joue un rôle fondamental dans le processus d’existence ; il est responsable de la définition des individualités et c’est le créateur des propriétés qui définissent les êtres humains. L’une des principales propriétés de l’être humain est la perception et l’intégration des différents sens nécessaires pour interagir avec l’environnement. Les outils de neuroimagerie et les recherches en neurosciences fournissent une aide précieuse pour étudier ces phénomènes, et l’électroencéphalogramme (EEG) apparaît comme un outil efficace pour les mesures non invasives des rythmes cérébraux.

Historiquement, ces approches ont utilisé des stimuli visuels et ont exploré la voie neuronale visuelle. Cependant, d’autres modalités sensorielles, comme les stimuli auditifs, ou a fortiori haptiques, se sont révélées être un défi en soi, car le décodage des corrélats neuronaux est assez complexe à comprendre dans le cas de deux voies sensorielles ou plus. Dans la vie réelle, l’homme doit faire face à de multiples stimuli et, avec les progrès de la technologie, il est nécessaire de les contrôler efficacement. Cela incite à mieux comprendre l’activité cérébrale sous-jacente dans le cas de l’implication de plusieurs sens.

La plupart des expériences réalisées jusqu’à présent n’utilisent que des signaux audiovisuels. L’ajout de l’haptique rend l’expérience encore plus intéressante et constitue un défi que nous prévoyons de résoudre dans le cadre de ce travail, et c’est ce qui rend cette technique novatrice. Ce travail est basé sur la compréhension de l’intégration de l’information dans trois voies neuronales du cerveau tout en appliquant les signaux haptiques-audio-visuels (HAV).

La nouveauté se situe à deux niveaux :

1. Une base de données EEG riche sur le plan neurophysiologique utilisant ce nouveau protocole d’acquisition HAV.

2. Un cadre scientifique novateur et efficace transférable aux technologies synthétiques à venir simulant des scénarios de la vie réelle.

Département Intelligence Ambiante et Systèmes Interactifs (LIST)Service Interactions et RéseauxLaboratoire d’Interfaces Sensorielles & Ambiantes

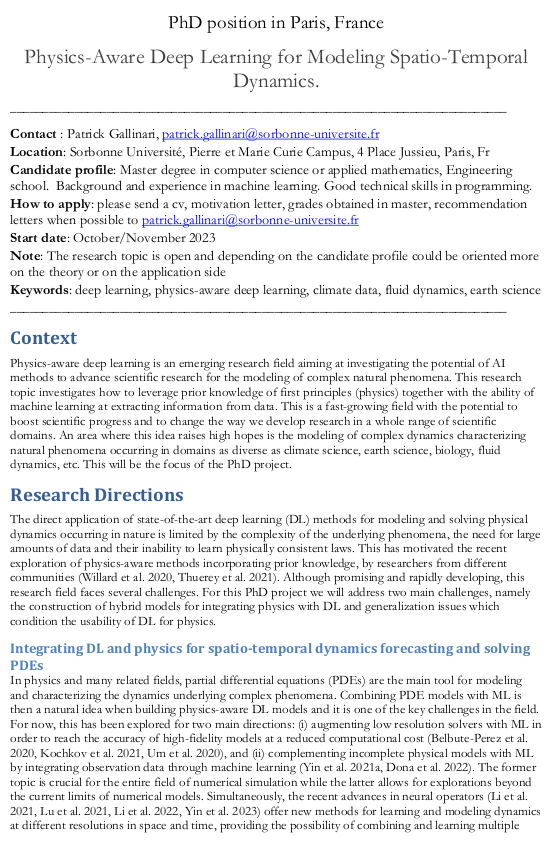

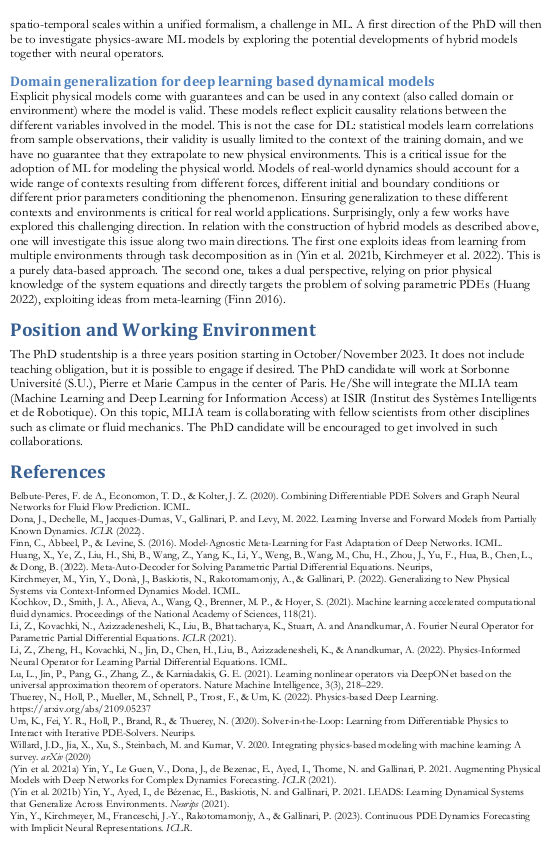

Physics-Aware Deep Learning for Modeling Spatio-Temporal Dynamics.

Contact : Patrick Gallinari, patrick.gallinari@sorbonne-universite.fr

Location: Sorbonne Université, Pierre et Marie Curie Campus, 4 Place Jussieu, Paris, Fr

Candidate profile: Master degree in computer science or applied mathematics, Engineering school. Background and experience in machine learning. Good technical skills in programming.

How to apply: please send a cv, motivation letter, grades obtained in master, recommendation letters when possible to patrick.gallinari@sorbonne-universite.fr

Start date: October/November 2023

Note: The research topic is open and depending on the candidate profile could be oriented more on the theory or on the application side

Keywords: deep learning, physics-aware deep learning, climate data, fluid dynamics, earth science

Full description: https://pages.isir.upmc.fr/gallinari/open-positions/Abstract: Physics-aware deep learning is an emerging research field aiming at investigating the potential of AI methods to advance scientific research for the modeling of complex natural phenomena. This is a fast-growing field with the potential to boost scientific progress and to change the way we develop research in a whole range of scientific domains. An area where this idea raises high hopes is the modeling of complex dynamics characterizing natural phenomena occurring in domains as diverse as climate science, earth science, biology, fluid dynamics, etc. Although promising and rapidly developing, this research field faces several challenges. For this PhD project we will address two main challenges, namely the construction of hybrid models for integrating physics with DL and generalization issues which condition the usability of DL for physics.

Ph.D. Thesis proposal – University of Caen Normandu (UNICAEN) and GREYC Research Lab – IMAGE and SAFE Teams – 2023

Subject: Latent representation manipulation for face editing in images and videos

Team and Lab: IMAGE tream, GREYC (UMR CNRS 6072) Research lab.

Thesis advisors: Christophe Charrier (Associate Professor at UNICAEN), Olivier Lézoray (Full Professor at UNICAEN), Sébastien Bougleux (Associate Professor at UNICAEN)

Emails: {christophe.charrier,olivier.lezoray,sebastien.bougleux}@unicaen.frPhD thesis subject: A generative AI is a machine learning algorithm that can generate content such as images or text. They are used in many fields and some of them have received a lot of attention from the scientific and general public communities. Face image generative AIs can be considered to edit an existing face, i.e., to modify the characteristics of a person’s face. In this thesis we propose to investigate the editing of facial attributes for biometric recognition. The editing of facial attributes of the searched person could then allow to improve the performance of face recognition by adding or removing facial attributes. The thesis work will focus on the de- velopment of new methods for editing facial attributes of faces with guarantees regarding the preservation of biometric properties. These methods will be applied to improve the search for people in databases, by counte- racting possible changes in the appearance of faces.

Qualifications:Candidates must have an MSc or engineering degree in a field related to computer science, electrical engineering, or applied mathematics, with strong programming skills (in particular with deep learning frameworks). Experience with image processing and/or biometrics will be a plus. Candidates are expected to have abilities to write scientific reports and communicate research results at conferences in English.

Information and application: Applications should include the following documents in electronic format : i) A short motivation letter stating why you are interested in this thesis, ii) A detailed CV describing your experience / research background related to the position iii) The transcripts for master degrees. iv) The contact information for three references (do not include the reference letters with your applications as we will only ask for the reference letters for short-listed candidates). Please send your application package by email to the co-advisors.

Location:The position will start in October 2023, and will be located in Caen, France. Ideally located in the heart of Normandy, two hours from Paris and just 10 minutes away from the beaches, Caen, William the Conqueror’s hometown, is a lively and dynamic city.

Thèse “Sécurisation de l’apprentissage fédéré par désapprentissage” F/HOrange Innovation (Orange Labs), Châtillon, 92320https://orange.jobs/jobs/v3/offers/124864?lang=FRhttps://orange.jobs/jobs/v3/offers/124864?lang=EN

Votre rôle est d’effectuer un travail de thèse sur la : « Sécurisation de l’apprentissage fédéré par désapprentissage »

La cybersécurité est devenue un enjeu majeur dans un monde de plus en plus digital. En effet, les cyberattaques se multiplient aussi bien contre les grands groupes que les particuliers. Ces attaques sont de plus en plus sophistiquées et menacent désormais les modèles de Machine Learning (ML) [1]. Les chercheurs ont ainsi montré la vulnérabilité du ML et la nécessité de les sécuriser [2].

Parmi ces attaques contre le ML, nous pouvons citer l’attaque par empoisonnement où l’attaquant introduit ou modifie des données d’apprentissage afin de corrompre le modèle de la victime. L’attaquant peut ainsi introduire une porte dérobée dans le modèle afin qu’en présence d’un motif (pattern) le comportement du modèle change conformément à son objectif [3]. Par exemple, pour une voiture autonome, l’attaquant pourrait tromper l’IA en apposant un auto-collant vert sur un panneau « stop » pour qu’il soit reconnu comme une limitation à 90 km/h. Pour cela, il lui suffirait de modifier la base d’apprentissage en introduisant des images d’un panneau « stop » avec le label « stop » (données saines) accompagnées de ces mêmes images mais après ajout d’un petit carré vert avec le label « 90 » (données malveillantes).

S’il est difficile à un attaquant d’avoir un accès privilégié à une base d’apprentissage, il lui en revanche plus facile d’introduire ses données malveillantes dans un contexte d’apprentissage collaboratif (AC).

Dans le domaine de l’AC, l’apprentissage fédéré (AF) est un nouveau paradigme de ML permettant à des participants de collaborer pour apprendre un modèle global tout en garantissant la confidentialité des données [4]. Ainsi, au lieu de partager leurs données, les participants partagent les paramètres de leurs modèles. Cette approche connait actuellement un large intérêt notamment chez Orange. Toutefois, elle est plus vulnérable au risque d’attaques par empoisonnement du fait de la probabilité d’avoir un attaquant parmi la diversité des participants [5].

La particularité des portes dérobées est qu’elles sont introduites en modifiant subtilement la base d’apprentissage. Il est donc difficile de les détecter lors de l’apprentissage et elles sont souvent découvertes en production. L’apprentissage étant un processus coûteux, il n’est pas envisageable de supprimer le modèle. Il est donc nécessaire de désapprendre la contribution des attaquants [6,7,8].

L’objectif de la thèse est de proposer de nouveaux algorithmes de désapprentissage pour l’AF. Pour cela, il sera nécessaire de bien comprendre les mécanismes d’attaque contre l’AF et le ML afin de développer un framework permettant de reproduire ces attaques. Les principaux verrous à lever seront :

Références[1] https://www.microsoft.com/en-us/security/blog/2020/10/22/cyberattacks-against-machine-learning-systems-are-more-common-than-you-think/[2] Enisa, “Securing Machine Learning Algorithm”, 2021, https://www.enisa.europa.eu/publications/securing-machine-learning-algorithms[3] Schwarzschild at al., “Just How Toxic is Data Poisoning? A Unified Benchmark for Backdoor and Data Poisoning Attacks”, 2020[4] McMahan et al., “Communication-Efficient Learning of Deep Networks from Decentralized Data”, 2016[5] Bagdasaryan et al., “How To Backdoor Federated Learning”, 2018[6] Fraboni et al., “Sequential Informed Federated Unlearning: Efficient and Provable Client Unlearning in Federated Optimization”, 2022[7] Liu et al., “Federated Unlearning”, 2020[8] Halimi et al., “Federated Unlearning: How to Efficiently Erase a Client in FL?”, 2022[9] Chen et al., “Detecting Backdoor Attacks on Deep Neural Networks by Activation Clustering”, 2018